LangSmith 通过动态少样本示例增强 LLM 应用程序

realtime news Aug 06, 2024 18:07

LangSmith 引入了动态少样本示例选择器,通过根据用户输入动态选择相关示例,提高 LLM 应用程序的性能。

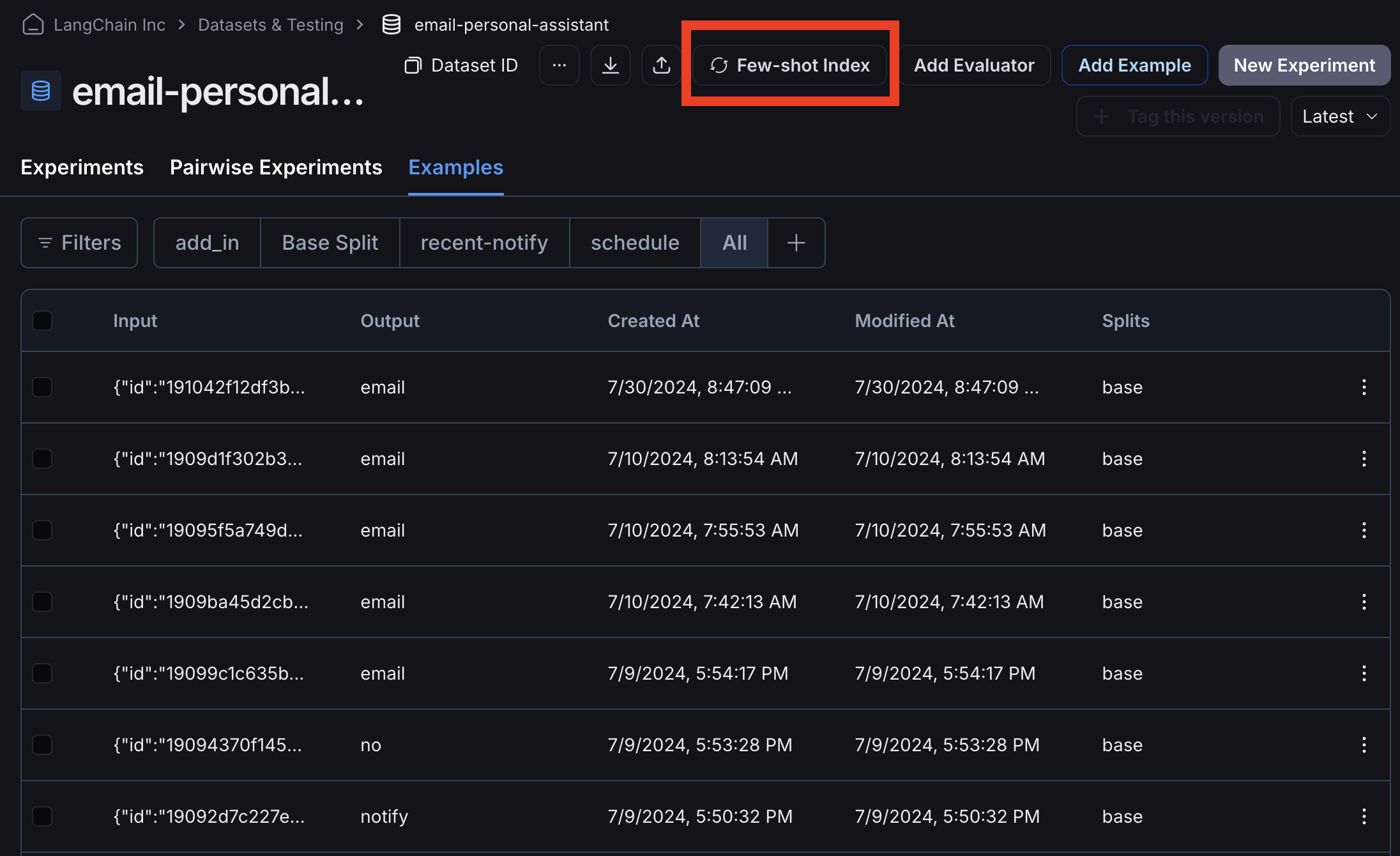

LangSmith 推出了一项新功能,有望提升使用大语言模型 (LLM) 的应用程序性能。根据 LangChain 博客,该公司在其 LangSmith 平台上推出了动态少样本示例选择器。这个创新功能允许用户通过一次点击即可在他们的数据集中索引示例,并根据用户输入动态选择最相关的少样本示例。

优化模型性能的挑战

少样本提示是提高模型性能的常用技术,通过在模型提示中包含示例输入和期望输出来实现。通常,开发者使用 3-5 个示例以避免上下文窗口过载。然而,随着应用程序复杂性的增加,可能需要数百甚至数千个示例来满足各种用户需求。将如此大规模的数据集添加到每个请求中是不切实际的,因为这会增加令牌成本和延迟。

微调通常被认为是处理大量示例的下一个最佳选项。虽然有效,但微调有几个缺点,包括复杂性、难以使用新示例更新,以及需要专门的基础设施和专业知识。此外,它缺乏为不同用户个性化示例的灵活性,使其不太适合快速迭代和个性化应用。

LangSmith 中的动态少样本示例

动态少样本提示通过允许根据用户输入选择最相关的示例来解决这些挑战。这种技术仍然使用一组小的 3-5 个示例,但动态选择它们,因此覆盖了更广泛的选项,并且在性能上优于静态数据集。LangSmith 集成了这一功能,以简化数据集管理并增强 LLM 应用程序的性能。用户只需一次点击,即可索引他们的数据集并检索与新输入最相似的示例列表,从而更容易快速迭代和个性化应用程序。

与微调相比,动态少样本提示在技术上更简单,更容易保持更新,并且需要的专业基础设施最少。这种方法允许开发人员根据用户输入检索相关示例,从而实现快速迭代和个性化应用程序。

目前,LangSmith 中的动态少样本提示处于封闭测试阶段,预计本月晚些时候公开发布。感兴趣的用户可以报名等待名单。有关如何使用动态少样本提示的更多详细信息,LangSmith 提供了详细的技术文档和视频演示。

Image source: Shutterstock